Les agents IA, aussi appelés agents autonomes, passent rapidement de démonstrations impressionnantes à des outils réels capables d’agir à votre place, et OpenClaw est l’un des projets qui suscite le plus d’attention. Vous avez peut‑être aussi vu ce logiciel sous les noms Clawdbot ou Moltbot, appellations employées à différentes étapes du développement par son auteur, le développeur autrichien Peter Steinberger.

Présenté comme un assistant personnel autonome pouvant piloter des logiciels pour vous, il soulève aussi des questions importantes sur les accès et la sécurité.

- Les agents IA sont des systèmes autonomes capables d’agir, pas seulement des outils conversationnels.

- Des projets comme OpenClaw montrent la puissance des agents IA auto‑hébergés.

- Cette puissance introduit de nouveaux risques de sécurité quand les agents traitent des sources non fiables.

- L’injection de prompt est une menace clé pour les agents IA, encore plus que pour les chatbots.

- La mémoire persistante peut amplifier les erreurs et prolonger les attaques.

- Les agents IA sont puissants, mais ils ne doivent pas être considérés comme sûrs par défaut pour la plupart des utilisateurs.

Pourquoi OpenClaw fait‑il tant parler de lui ?

OpenClaw attire l’attention car il symbolise le passage d’une IA qui répond à des questions à une IA capable d’exécuter des tâches sur un système réel et d’utiliser des logiciels. Les enjeux de sécurité ont rendu OpenClaw particulièrement discuté dans les milieux de la sécurité. Qu’est‑ce qui séduit développeurs et utilisateurs avancés ?

OpenClaw se distingue parce qu’il peut accomplir des actions concrètes, et pas seulement générer du texte ou des suggestions. Plutôt que de vous dire ce qu’il faut faire, il peut exécuter lui‑même des opérations. La technologie peut ouvrir des applications, envoyer des messages, déplacer des fichiers, lancer des commandes et interagir directement avec des systèmes en votre nom.

Ce niveau d’automatisation suscite l’intérêt : développeurs et utilisateurs avancés y voient un moyen de réduire les tâches répétitives ou d’automatiser des flux de travail. L’idée d’un agent IA qui « fait le travail » plutôt que de rester en arrière‑plan est particulièrement séduisante.

C’est cette promesse d’action concrète qui a fait basculer OpenClaw d’un projet de niche vers des débats plus larges.

Pourquoi cela dépasse le seul cas OpenClaw

OpenClaw offre un exemple visible d’une tendance plus large vers des agents IA réellement actifs, et non simplement réactifs.

Les questions d’usage abusif deviennent inévitables à mesure que ce type de technologie se développe. OpenClaw illustre la direction que prend l’IA. Cela le rend pertinent au‑delà d’un projet isolé et alimente les discussions sur les contrôles à mettre en place. Peut‑on leur faire confiance ?

Que sont les agents IA et en quoi diffèrent‑ils des autres outils IA ?

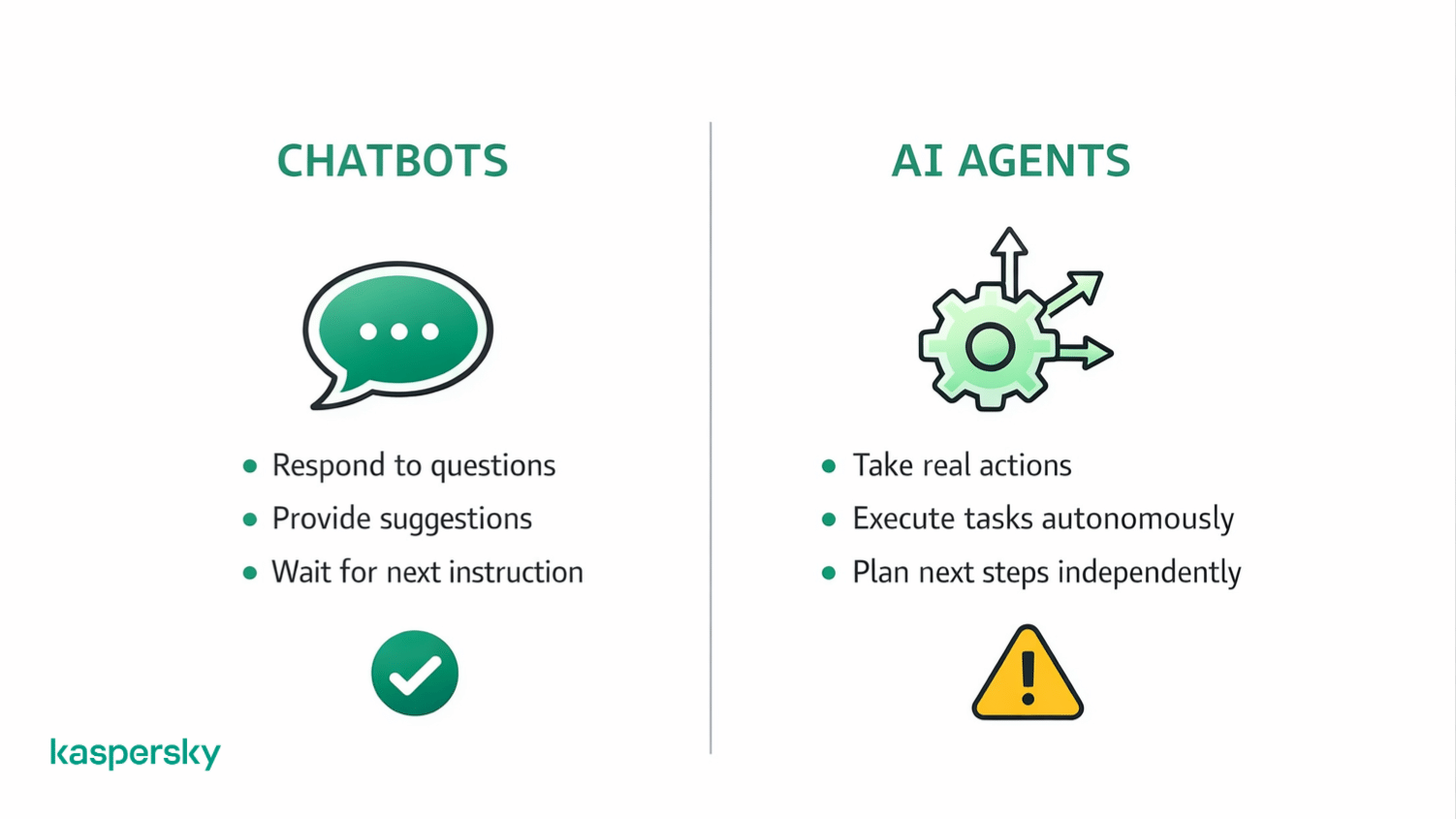

Les agents IA ne se contentent pas de fournir des réponses textuelles ou vocales à vos questions. Ils peuvent planifier des étapes et exécuter des actions pour atteindre un objectif. Au lieu de s’arrêter à un simple conseil, ils décident quoi faire ensuite et l’exécutent.

Un agent IA peut observer une situation et intervenir. C’est différent de la plupart des outils IA qui réagissent à des requêtes mais attendent la consigne suivante. Des exemples précoces incluent des agents d’exécution de tâches comme Manus (aujourd’hui détenu par Meta). Manus illustre comment les agents peuvent dépasser le chat pour passer à l’action : analyse de données, écriture de code pour résoudre un problème, etc., sans qu’on ait à leur dicter chaque étape. L’intervention humaine est moindre.

OpenClaw reprend cette idée d’agents IA capables d’agir, mais l’applique de manière plus directe et robuste.

OpenClaw est‑il un agent IA classique ou quelque chose de plus avancé ?

OpenClaw relève bien de la catégorie des agents IA. Il propose une implémentation plus puissante que beaucoup d’outils que le grand public connaît aujourd’hui.

Cet outil IA peut planifier des tâches et agir sans saisie constante. OpenClaw peut interagir directement avec des logiciels et le système d’exploitation, pas seulement avec des API limitées ou des outils restreints. Cet accès élargi augmente son utilité mais augmente aussi l’enjeu en termes de sécurité.

Pourquoi les agents IA auto‑hébergés sont différents

Les agents IA auto‑hébergés s’exécutent localement sur votre propre système plutôt que sur un service distant. Cela donne aux utilisateurs un meilleur contrôle sur la configuration et le comportement, mais déplace aussi les responsabilités.

Quand un agent a un accès local, la sécurité dépend de sa configuration, des permissions accordées et de la surveillance. Plus de contrôle implique aussi plus de risques.

Des projets récents montrent que le concept d’« auto‑hébergement » évolue. Par exemple, Moltbot (anciennement Clawdbot) peut désormais s’exécuter via Moltworker, une solution open source de Cloudflare. Cela supprime le besoin d’un matériel local dédié en faisant tourner l’agent sur une plateforme gérée.

Cette approche réduit la difficulté d’accès et simplifie l’installation, mais elle déplace aussi le lieu de contrôle. Quand un agent s’exécute sur une infrastructure cloud, la sécurité dépend non seulement de l’agent lui‑même, mais aussi des contrôles d’accès et de la manière dont les données et permissions sont gérées sur la plateforme.

Par exemple, un utilisateur peut connecter un agent IA à sa messagerie en pensant que l’agent lira seulement les messages, alors que la configuration cloud lui permet aussi d’envoyer des courriels si cette autorisation n’est pas explicitement désactivée.

En quoi les agents IA diffèrent‑ils des chatbots comme ChatGPT ?

Les chatbots comme ChatGPT répondent ; les agents IA agissent.

Un chatbot peut vous donner des suggestions ou des explications. Un agent IA peut ouvrir des programmes ou exécuter des workflows.

Par exemple, certaines personnes ont utilisé OpenClaw pour automatiser des transactions financières. Elles ont défini des règles et demandé à l’agent IA non seulement de conseiller (ce que ChatGPT peut faire) mais d’exécuter effectivement des ordres de trading.

Pourquoi les agents IA posent‑ils de nouveaux risques de sécurité ?

Comme expliqué précédemment, les agents IA prennent des mesures plutôt que de se contenter de donner des conseils. Cela s’accompagne souvent d’un accès à des fichiers, des applications ou des fonctions système.

L’accès système et l’autonomie conférés à OpenClaw modifient à la fois l’impact et le risque. OpenClaw demandera des permissions pour interagir avec des logiciels ou accomplir des actions comme envoyer un e‑mail ou remplir des formulaires sans supervision humaine. Cela en fait un facteur d’incertitude.

Les erreurs ou manipulations peuvent avoir des conséquences réelles. Le risque ne se limite pas à ce qu’on ordonne à l’agent de faire, mais inclut aussi ce qu’il interprète comme des instructions pendant l’exécution d’une tâche.

Pourquoi les entrées non fiables sont un problème central

Les agents IA consomment de grandes quantités de contenu externe (pages web, documents, etc.) pour décider de leurs actions. Ce contenu n’est pas toujours fiable.

Les consignes n’ont pas besoin d’être explicites : elles peuvent être cachées dans du texte ou des données que l’agent lit en effectuant une tâche. Cela permet à des attaquants d’influencer le comportement d’un agent sans interagir directement avec lui.

Cela ouvre la voie à l’injection de prompt : l’utilisation d’entrées non fiables pour orienter un agent vers des actions qu’il n’était pas censé accomplir.

Les outils IA puissants exigent des protections renforcées

Les agents IA peuvent accéder à des fichiers, des courriels et des fonctions système. Kaspersky Premium aide à détecter les activités suspectes, bloquer les scripts malveillants et protéger vos appareils contre les menaces réelles.

Essayer Kaspersky Premium gratuitementQu’est‑ce que l’injection de prompt pour les agents IA ?

L’injection de prompt consiste à manipuler un agent IA en lui fournissant du contenu non fiable qui modifie son comportement.

Le risque n’est pas nécessairement un bug logiciel. C’est que l’agent puisse considérer des entrées externes — comme des messages ou des commentaires — comme des instructions. Dans ce cas, l’agent peut être guidé vers des actions non prévues.

Comment l’injection de prompt se produit dans la réalité

L’injection de prompt peut être directe ou indirecte.

- Directe — un attaquant inclut délibérément des instructions dans le contenu que l’agent va lire.

- Indirecte — l’agent capte des instructions cachées ou inattendues sur un site web ou dans un message traité pendant ses tâches normales.

Le problème principal est comportemental : l’agent peut suivre ce qu’il interprète comme des directives, même si ces dernières proviennent de sources non fiables. Aucun bug classique n’est nécessaire pour que cela se produise.

Pourquoi l’injection de prompt est plus dangereuse pour les agents que pour les chatbots

Dans un chatbot, des instructions injectées affectent principalement les réponses et les conseils. Avec des agents IA, elles peuvent influencer des actions concrètes.

Si un agent a accès à des fichiers ou au contrôle système, des instructions manipulées peuvent provoquer des changements réels. C’est pourquoi l’injection de prompt représente un risque plus important pour les agents : la même technique qui fausse la sortie textuelle d’un chatbot peut déclencher des opérations involontaires lorsqu’un agent est impliqué.

Qu’est‑ce que la mémoire persistante chez les agents IA ?

La mémoire persistante permet à un agent IA de conserver des informations dans le temps. Il peut ainsi réutiliser des entrées précédentes pour orienter ses décisions futures au lieu de repartir de zéro à chaque nouvelle tâche.

Ce que signifie la mémoire persistante pour les agents IA

Un agent IA peut stocker du contexte et des consignes entre les sessions, et développer des « comportements » préférentiels. Cela rend l’agent plus efficace en se souvenant de ce qu’il a appris ou réalisé auparavant.

Cela signifie aussi que des informations anciennes peuvent influer sur des actions ultérieures. Des consignes ou hypothèses acquises lors d’une tâche précédente peuvent continuer à orienter le comportement de l’agent dans une situation différente, même si l’utilisateur n’en a plus conscience.

Pourquoi la mémoire persistante augmente les risques

La mémoire persistante peut introduire des effets différés. Une instruction malveillante peut ne pas causer de problème immédiat, mais réapparaître plus tard lorsque les conditions s’y prêtent.

La suppression des impacts devient alors plus difficile. Un comportement stocké peut se reproduire à travers différentes tâches. Restaurer complètement un agent implique souvent de vider sa mémoire ou de reconstruire ses configurations pour garantir la suppression des influences indésirables.

Que se passe‑t‑il lorsqu’un agent IA est mal configuré ou exposé ?

Un agent IA peut être accessible ou manipulé d’une manière que son propriétaire n’avait pas prévue, transformant un outil utile en risque de sécurité.

Cela peut résulter d’un accident ou d’une mauvaise compréhension. Des tiers peuvent aussi tenter de manipuler l’agent.

Comment les agents IA peuvent être exposés involontairement

L’exposition survient souvent à cause d’erreurs simples. Une authentification faible ou des permissions trop larges peuvent rendre un agent accessible en dehors de son environnement prévu.

Faire tourner un agent localement ne garantit pas la sécurité. S’il se connecte à Internet ou interagit avec d’autres systèmes, il peut être influencé. Le contrôle local réduit certains risques, mais n’élimine pas la menace.

Pourquoi un agent exposé devient une surface d’attaque

Une fois exposé, un agent IA devient un objet d’étude pour des attaquants : ils peuvent le sonder, tester ses réactions et tenter de le manipuler. Ils chercheront à lui fournir des entrées ciblées, déclencher des actions ou découvrir son comportement au fil du temps.

Parce que les agents peuvent agir réellement, l’abus ne ressemble pas forcément à une attaque informatique classique. La manipulation peut consister à orienter son comportement, extraire des données ou provoquer des changements système non souhaités, sans exploiter une faille logicielle traditionnelle.

Qu’est‑ce que la « trifecta mortelle » en sécurité des agents IA ?

La « trifecta mortelle » décrit trois conditions qui, combinées, créent un risque sérieux pour la sécurité des agents IA.

Les trois conditions qui permettent des attaques graves

- La première condition est l’accès à des données sensibles, comme des fichiers, des identifiants ou des informations internes.

- La deuxième est la présence d’entrées non fiables, c’est‑à‑dire des contenus que l’agent ne peut pas entièrement vérifier.

- La troisième est la capacité à effectuer des actions externes, comme envoyer des requêtes, modifier des systèmes ou exécuter des commandes.

Pris séparément, ces éléments peuvent être gérables. Ils deviennent dangereux lorsqu’ils se combinent. Un agent capable de lire des entrées non fiables et d’agir crée une voie claire pour la manipulation. Contrôler les actions autorisées d’un agent est donc essentiel.

Les utilisateurs lambda doivent‑ils utiliser des agents IA aujourd’hui ?

Pour la plupart des personnes, les agents IA restent des outils expérimentaux. Ils peuvent être utiles dans des contextes adaptés, mais introduisent aussi des risques pas toujours évidents.

Quand il peut être raisonnable d’utiliser un agent IA

Un agent IA peut avoir du sens dans des scénarios contrôlés et à faible risque, par exemple lors d’expérimentations sur un appareil isolé. Certaines personnes font tourner des agents qui ne traitent que des tâches non sensibles, comme organiser des fichiers ou tester des flux de travail.

Par exemple, si vous voulez que l’agent prépare un itinéraire pour un voyage, il peut accéder aux informations nécessaires tout en étant empêché de contacter des personnes ou d’effectuer des actions potentiellement dommageables.

Si vous savez gérer les paramètres et que les erreurs éventuelles n’ont pas de conséquences importantes, un agent peut servir d’outil d’apprentissage. L’essentiel est de limiter le périmètre et de restreindre strictement les accès.

Quand les agents IA sont une mauvaise idée

Les agents IA sont déconseillés quand ils ont accès à des données sensibles ou à des comptes importants. Faire tourner des agents sans comprendre les permissions ou les dangers liés aux entrées externes augmente rapidement les risques.

Il est aussi parfaitement légitime de choisir de ne pas utiliser d’agent. Ne pas en déployer aujourd’hui est une décision raisonnable si la commodité se fait au détriment de la sécurité ou de votre tranquillité d’esprit.

Quelles protections de base sont essentielles lorsque l’on utilise des agents IA ?

Des protections élémentaires réduisent les risques et empêchent que des erreurs deviennent des problèmes graves.

Les logiciels Kaspersky ajoutent une couche supplémentaire de protection en signalant les comportements suspects et en aidant à protéger les comptes contre les compromissions. Nos forfaits bloquent tout, depuis les malwares et virus jusqu’aux ransomwares et applications d’espionnage.

Quelles mesures de sécurité sont prioritaires

L’isolation est essentielle. Exécutez les agents sur des appareils et comptes séparés quand c’est possible, afin qu’ils ne puissent pas affecter des données ou systèmes importants. Limitez les permissions au strict nécessaire : évitez d’accorder par défaut un accès complet au système ou aux comptes.

Les étapes d’approbation importent aussi. Exiger une confirmation avant les actions sensibles crée un temps de pause qui peut prévenir des opérations involontaires, comme des dépenses engagées en votre nom. Ces contrôles simples ont un impact important sans ajouter beaucoup de complexité.

Que signifient les agents IA pour l’avenir de l’IA grand public ?

Les agents IA annoncent un futur où les outils IA font plus que conseiller : ils agissent. Mais cette évolution s’accompagne de compromis que les consommateurs apprennent encore à gérer.

Ce que ce moment nous dit de la maturité des agents IA

Les agents IA sont puissants mais immatures. Ils peuvent automatiser des tâches, mais peinent encore sur certains aspects de jugement et de sécurité. Cela ne signifie pas qu’ils ne deviendront pas plus sûrs ou fiables, mais il faut garder des attentes réalistes.

Les agents IA montrent la direction prise par la technologie, mais un déploiement large et courant nécessitera de meilleures protections et des outils conçus dès le départ avec la sécurité en tête.

Articles connexes :

- Comment ChatGPT traite‑t‑il les enjeux de cybersécurité et les risques potentiels ?

- Quels sont les risques liés à la cybercriminalité alimentée par l’IA dans le paysage numérique actuel ?

- Comment l’IA et le machine learning renforcent‑ils les mesures de cybersécurité ?

- Quels sont aujourd’hui les dangers de la technologie deepfake ?

Produits recommandés :

FAQs

OpenClaw est‑il téléchargeable gratuitement ?

OpenClaw est disponible gratuitement sur GitHub. Il s’agit d’un logiciel open source, ce qui laisse la possibilité à des tiers de le modifier et de le redistribuer.

OpenClaw est‑il facile à installer ?

Des tutoriels permettent de lancer des bots rapidement, mais une configuration avancée demande du temps et des compétences spécialisées. C’est d’autant plus risqué d’exécuter un logiciel qui n’a pas été correctement configuré.