Cela ressemble à un cliché de science‑fiction, et pourtant la technologie est déjà là — les arnaques vocales IA utilisent l'intelligence artificielle pour copier des voix réelles et usurper des personnes que vous connaissez. Le résultat : une voix familière n'est plus une preuve qu'un appel est authentique.

Les arnaques d'usurpation vocale liées à l'IA ne nécessitent pas le piratage d'appareils ni la compromission de systèmes de sécurité. Les escrocs misent sur l'urgence et la pression pour pousser les gens à agir avant qu'ils n'aient le temps de remettre en question ce qu'ils entendent. Les appels peuvent sembler calmes ou au contraire très émotionnels et pressants.

La réponse la plus sûre est simple : raccrochez et vérifiez la demande par un autre canal de confiance. Avec quelques habitudes et des outils de base, il est possible de réduire le risque de se faire avoir sans connaissances techniques.

L'essentiel à retenir :

- Les arnaques vocales IA utilisent des voix clonées ou des deepfakes pour se faire passer pour des personnes de confiance : une voix familière n'est plus la preuve qu'un appel est réel.

- Ces escroqueries jouent sur l'urgence et la pression émotionnelle, pas sur des failles techniques, pour vous empêcher de vérifier les demandes.

- Les situations les plus fréquentes sont les urgences familiales et l'usurpation d'autorité (supérieurs hiérarchiques, responsables d'entreprise).

- La réponse la plus sûre consiste à mettre fin à l'appel et à vérifier indépendamment via des coordonnées fiables.

- Des habitudes simples comme la vérification et l'utilisation d'outils de filtrage d'appels réduisent significativement le risque.

Qu'est‑ce qu'une arnaque vocale IA ?

Une arnaque vocale IA est une fraude où des attaquants utilisent l'intelligence artificielle pour générer ou cloner la voix d'une personne et l'employer lors d'appels téléphoniques ou de messages vocaux afin d'amener la victime à accomplir une action.

Ces escroqueries font partie de la catégorie plus large de l'hameçonnage, souvent appelées hameçonnage vocal ou vishing. Plutôt que des e‑mails ou des messages falsifiés, les fraudeurs comptent sur des voix réalistes pour instaurer la confiance et pousser les gens à réagir rapidement.

Ce type de cybercriminalité a déjà un impact important sur certains secteurs, notamment là où les demandes, validations ou assistances par téléphone sont fréquentes.

Les escrocs peuvent se faire passer pour un membre de la famille demandant de l'aide ou de l'argent de toute urgence. Ils peuvent prétendre être un responsable réclamant un paiement ou un agent du support affirmant qu'il y a un problème avec un compte. La voix paraît vraie parce qu'elle est reconstituée à partir d'enregistrements d'une personne réelle.

Les arnaques vocales IA sont ciblées et interactives. L'appelant peut répondre naturellement et ajuster le ton au fil de la conversation. Cela rend la situation plus personnelle et crédible, loin de l'automatisme d'un vieux robot‑appel.

Qu'est‑ce qu'une voix deepfake et comment est‑elle utilisée dans les arnaques ?

Une voix deepfake est une copie générée par l'IA de la voix d'une personne réelle, utilisée pour rendre une escroquerie convaincante. Cette technologie permet d'usurper quelqu'un que la victime connaît ou en qui elle a confiance.

Beaucoup d'entre nous utilisent désormais des assistants IA qui montrent combien les voix synthétisées peuvent paraître naturelles. La qualité s'améliore constamment et rend parfois floues les frontières entre ce qui est authentique et ce qui ne l'est pas.

Les voix deepfake sont un outil parmi d'autres dans les arnaques vocales IA. Elles sont souvent associées à des informations personnelles volées pour rendre les appels crédibles et pressants. C'est pourquoi la demande peut sembler raisonnable ou réaliste.

Beaucoup associent les deepfakes à de fausses vidéos en ligne plutôt qu'à des appels vocaux. C'est cet écart d'attente que les escrocs exploitent. Les gens ne sont pas toujours vigilants face au risque : quand une voix semble familière, on a tendance à agir vite sans vérifier.

Comment les escrocs clonent‑ils la voix d'une personne ?

Les escrocs clonent des voix en rassemblant de courts échantillons audio puis en utilisant des outils d'IA pour reproduire le timbre et l'intonation d'une personne. Parfois, quelques secondes d'élocution claire suffisent à obtenir une approximation convaincante.

Les échantillons vocaux sont parfois faciles à trouver : des vidéos publiques sur les réseaux sociaux ou de brèves conversations téléphoniques peuvent fournir suffisamment de matière. L'audio est ensuite traité par des outils de clonage qui apprennent le ton et les prononciations. Réfléchissez aux enregistrements que vous avez publiés sur les réseaux et que quelqu'un pourrait utiliser.

Le clonage vocal moderne est rapide et évolutif. Ce qui demandait autrefois des compétences très spécialisées peut désormais être réalisé rapidement avec des outils largement disponibles. C'est inquiétant, car cela permet aux escrocs de créer des voix convaincantes et de les réutiliser sur de nombreux appels ou victimes.

Pourquoi les arnaques vocales IA sont‑elles si convaincantes ?

Ces arnaques sont convaincantes parce qu'entendre une voix familière inspire immédiatement confiance. Dans des situations émotionnelles ou urgentes, les gens ne s'attendent pas à être trompés.

Les escrocs créent souvent de la pression en évoquant des urgences ou des problèmes nécessitant une action rapide, comme être bloqué dans une ville ou à l'étranger sans moyen de rentrer. La panique et le sentiment d'urgence réduisent la probabilité que la personne fasse une pause et vérifie, même si la demande semble inhabituelle ou contraire au caractère de la personne.

C'est la raison pour laquelle même des personnes très vigilantes peuvent être trompées. L'arnaque n'exploite pas une faiblesse technique, mais des réactions humaines normales face au stress et à l'émotion.

Protégez‑vous des arnaques vocales IA

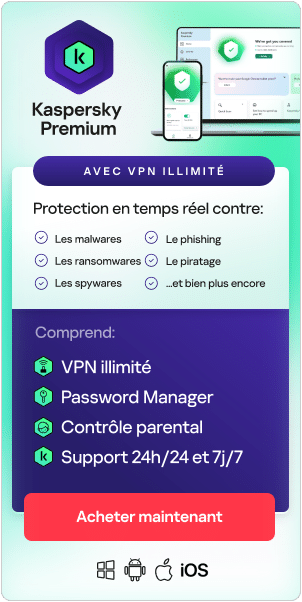

Protégez vos appareils avec Kaspersky Premium. Empêchez les accès non autorisés, sécurisez vos données et maintenez votre système en sécurité.

Essayer Kaspersky Premium gratuitementQuels sont les scénarios les plus courants d'arnaques vocales IA ?

La plupart des arnaques vocales IA reprennent des situations familières où l'on s'attend à recevoir des appels urgents et où la pression pousse à répondre rapidement. Cela complique ou rend inutile toute vérification sur le moment.

Arnaques vocales liées à une urgence familiale

Les arnaques familiales utilisent des voix clonées pour inventer des problèmes impliquant des proches.

Les victimes signalent souvent des appels affirmant qu'un proche a été arrêté ou blessé et qu'il a besoin d'argent en urgence. L'appelant peut supplier ou paraître en détresse. Il demandera probablement de ne pas raccrocher ni contacter d'autres personnes : cette pression émotionnelle vise à empêcher toute vérification et à garder la situation privée.

L'escroc peut exiger un paiement immédiat ou donner des instructions pour rester en ligne et expliquer pourquoi les moyens de contact habituels ne fonctionnent pas. L'objectif est la rapidité et la tromperie, pas une longue conversation.

Usurpation d'autorité au travail

Ces arnaques imitent des dirigeants ou des personnes en position officielle au travail, avec des voix calmes et assurées qui sonnent familières ou professionnelles.

Un niveau perçu d'autorité peut augmenter la probabilité d'obéissance. Quand une demande semble provenir d'un supérieur ou d'une institution de confiance, on suit plus facilement les instructions sans se poser de questions. Les appels peuvent concerner des paiements urgents ou des tâches confidentielles (deux signaux d'alerte).

Ces arnaques visent à la fois les téléphones professionnels et personnels, car les attaquants ciblent là où la confiance existe déjà. Un appel peut viser un appareil de travail pendant les heures ouvrables ou un téléphone personnel en dehors des heures.

Quels signes doivent immédiatement éveiller vos soupçons ?

Un appel vocal doit vous alerter s'il crée une urgence ou une pression qui vous empêche de vérifier la demande selon vos habitudes. Si l'appelant insiste pour la confidentialité ou appelle depuis un numéro inconnu, soyez sur vos gardes.

La personne qui tente d'arnaquer peut exiger que vous gardiez l'appel secret ou dire que personne d'autre ne peut être contacté. Cette isolation est volontaire : elle vise à couper toute vérification ou prise de conscience de ce qui se passe réellement.

Méfiez‑vous surtout des demandes impliquant des moyens de paiement inhabituels ou irréversibles comme des cartes cadeaux ou des crypto‑monnaies. Ces requêtes sont conçues pour déplacer l'argent rapidement et rendre le recouvrement difficile. La demande de cartes cadeaux est un indice évident d'arnaque.

Que faire si vous recevez un appel vocal suspect ?

La mesure la plus sûre est de raccrocher et de prendre de la distance face à la pression. Le moindre doute doit vous inciter à couper la communication.

Raccrochez. Cela rompt la prise émotionnelle et vous donne le temps de réfléchir clairement. Ne restez pas en ligne pour tenter de démêler la situation ni pour poser des questions de suivi : les escrocs utilisent la conversation pour adapter leur récit et trouver d'autres moyens de le rendre plus crédible.

Vérifiez la demande indépendamment en utilisant des coordonnées fiables. Exigez de traiter la situation via un numéro enregistré ou une adresse e‑mail connue. Évitez de poursuivre la conversation ou de rappeler le même numéro. Un interlocuteur légitime comprendra que vous vouliez vérifier ; un escroc tentera de l'empêcher.

Comment vous protéger à long terme contre les arnaques vocales IA ?

La protection à long terme consiste à réduire la fréquence à laquelle vous êtes ciblé et à compliquer la tâche des escrocs.

Les arnaques vocales IA reposent sur la confiance et l'urgence. Des habitudes simples et des mesures réalistes permettent de diminuer le risque sans modifier votre usage quotidien du téléphone.

Habitudes personnelles pour réduire le risque

De petites habitudes font une grande différence. Certaines familles ou cercles proches utilisent désormais des mots‑de‑code en cas de véritable urgence : un appel authentique peut ainsi être vérifié rapidement (sans divulguer le mot‑de‑code).

Faites attention aux enregistrements vocaux publics. Vidéos, notes vocales et messages d'accueil peuvent servir de matière première pour le clonage. Il n'est pas nécessaire d'arrêter tout partage, mais limiter les enregistrements longs ou très clairs réduit l'exposition.

Considérez la vérification comme normale et non comme impolie. Raccrocher pour rappeler ou vérifier auprès d'une autre personne doit être la règle. Utiliser un canal de contact fiable est une réponse raisonnable et toute personne authentique l'acceptera. Les escrocs tenteront de vous en dissuader : c'est un bon test pour filtrer les appels douteux.

Les logiciels peuvent‑ils réduire les appels d'arnaque vocale IA ?

Dans une certaine mesure seulement. Les outils de filtrage d'appels et de détection de spam analysent les modèles d'appel et les comportements inhabituels pour bloquer ou marquer les appels suspects avant que vous ne répondiez. Ils peuvent aussi repérer des numéros connus pour être malveillants.

Les protections au niveau du téléphone diminuent l'exposition en interrompant des campagnes d'escroquerie connues et en avertissant d'un risque probable. Elles ne détectent pas tous les appels, notamment les arnaques très ciblées qui utilisent de nouveaux numéros.

C'est pourquoi le logiciel doit être considéré comme une couche de soutien et non comme un remplacement du bon sens. La technologie réduit la fréquence des tentatives, mais la vérification humaine reste la défense la plus efficace quand un appel paraît réel.

Que faire si vous avez déjà envoyé de l'argent ou communiqué des informations ?

Contactez immédiatement votre banque ou le prestataire de paiement si de l'argent a été transféré ou si des coordonnées bancaires ont été fournies. Changez vos mots de passe et activez l'authentification à plusieurs facteurs sans délai. Si des données personnelles ont été divulguées, surveillez attentivement vos comptes pour détecter toute activité inhabituelle.

Agir rapidement après un envoi d'argent ou une fuite d'information peut limiter les dégâts et augmenter les chances de récupération.

Notez ce qui s'est passé tant que tout est encore frais. Conservez les détails de l'appel comme les numéros et les horaires pour en garder la trace comme preuve. Gardez aussi une note des instructions reçues. Ce dossier aide les fournisseurs et les autorités à réagir plus rapidement et peut empêcher d'autres personnes d'être victimes du même stratagème.

Pourquoi les arnaques vocales IA vont probablement augmenter et comment rester prudent

Ces arnaques vont probablement se multiplier parce que la voix offre un moyen convaincant pour les escrocs d'usurper quelqu'un. Il est plus simple pour les fraudeurs d'exploiter cette confiance à grande échelle, et les techniques s'améliorent.

La seule familiarité ne suffit plus comme preuve. Cela ne signifie pas pour autant que l'on est sans défense. La vérification fonctionne encore, même si les arnaques deviennent plus sophistiquées. Raccrocher et vérifier l'identité sont des moyens puissants pour stopper net une escroquerie.

Faire de la vérification une habitude normale permet de reprendre la main. De bonnes pratiques continuent de faire une grande différence et aident à éviter de se faire piéger. La sensibilisation, c'est aussi savoir que tout n'est peut‑être pas ce qu'il paraît lorsqu'on vous appelle.

Articles connexes :

- Ce qu'il faut savoir sur les arnaques de hameçonnage

- Comment éviter de devenir victime d'arnaques en ligne

- Qu'est‑ce que le vishing ?

- Comment se protéger contre le piratage via l'IA ?

Produits recommandés :

FAQs

Les arnaqueurs peuvent‑ils cloner votre voix à votre insu ?

Oui. Des vidéos publiques ou de courts enregistrements peuvent suffire à cloner une voix sans contact direct.

Qui sont les principales cibles des arnaques vocales IA ?

N'importe qui peut être visé, mais les escrocs ciblent souvent les personnes dont la voix ou les informations personnelles sont faciles à trouver en ligne.

Les arnaques vocales IA sont‑elles illégales ?

La fraude, y compris l'utilisation de voix clonées pour tromper, est illégale dans de nombreux pays, même si la technologie elle‑même peut être légale.